チャットボットは単なる便利ツールから私たちの生活に欠かせないパートナーへと進化を遂げました。この記事では1960年代の初期プログラムから最新の自律型エージェントまで、その壮大な歴史を紐解きます。

私が長年テクノロジーの動向を追う中で見えてきた、AIと人間の関係性の変化についても詳しく解説しましょう。機械との対話は人類にとって長年の夢であり、技術的な挑戦の連続でした。

第1世代・第2世代|ルールベースと初期の実験

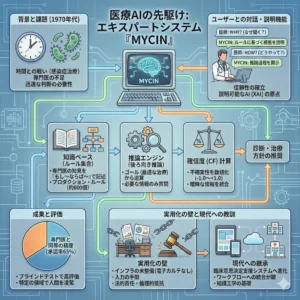

コンピュータがまだ計算機としての役割しか持たなかった時代に、最初の対話型プログラムは産声を上げました。当時のシステムは非常に単純な仕組みでしたが、人間と機械の関係性について深い洞察を与えてくれます。

私が特に興味深いと感じるのは、技術的な制約の中でいかに人間らしさを演出しようとしたかという工夫です。ここでは初期の代表的なボットと、その後の発展を支えた技術について見ていきます。

ELIZA(イライザ)|最初の対話者とその衝撃

1966年にMITで開発されたELIZAは、史上初のチャットボットとして歴史に名を刻んでいます。ジョセフ・ワイゼンバウムによって作られたこのプログラムは、心理療法士を模倣するように設計されました。

ELIZAは相手の言葉をオウム返しにしたり、質問で返したりすることで会話を成立させます。私が実際にログを見たときも、その単純ながら巧みな対話術に驚かされました。

パターンマッチングの仕組み

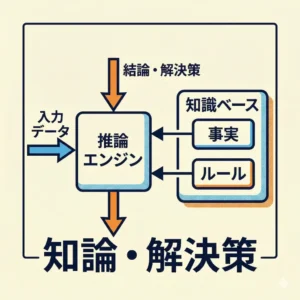

ELIZAの内部構造は、現代のAIと比べると驚くほどシンプルです。あらかじめ登録されたキーワードを探し出し、それに対応するテンプレートを当てはめる「パターンマッチング」という手法を採用しています。

例えば「母のことで不満がある」と入力されると、「母」という単語に反応して「家族についてもっと教えてください」と返します。ここには本当の意味での理解はなく、表面的な言葉の置き換えしか行われていません。

イライザ効果という心理現象

ELIZAがもたらした最大の発見は、技術そのものよりも人間の心理に関するものでした。多くのユーザーが、相手がただのプログラムであると知りつつも、そこに人間的な感情や知性を感じ取ってしまったのです。

この現象は「イライザ効果」と呼ばれ、私たちが無意識に機械を擬人化してしまう傾向を示しています。この発見は現代のAI開発においても、ユーザーインターフェースを設計する上で重要な教訓となり続けています。

PARRYと精神病理モデル|偏執的な対話

ELIZAから数年後の1972年、スタンフォード大学でPARRYというボットが開発されました。ELIZAが「聞く側」のセラピストだったのに対し、PARRYは「話す側」の患者をシミュレートしています。

具体的には偏執的統合失調症の症状を持つ人物として振る舞うようプログラムされていました。私がこの対比を面白いと感じるのは、正常な対話を目指すのではなく、あえて病的な思考プロセスを再現しようとした点です。

PARRYは「恐怖」や「怒り」といった内部状態変数を持ち、会話の流れによって反応が変化します。相手が攻撃的な質問をすれば怒りのレベルが上がり、妄想的な発言が増えるという仕組みでした。

A.L.I.C.E.とAIML|知識記述の民主化

1995年に登場したA.L.I.C.E.は、ルールベース型チャットボットの集大成とも言える存在です。開発者のリチャード・ウォレス博士は、誰でも簡単にボットを作れる仕組みを考案しました。

それがAIML(Artificial Intelligence Markup Language)という記述言語です。私はこの技術が、チャットボット開発の敷居を劇的に下げたと評価しています。

AIMLを使えば、プログラミングの深い知識がなくてもXML形式で会話ルールを記述できます。このオープンソース性は多くの開発者を惹きつけ、世界中で数千ものクローンボットが生まれるきっかけとなりました。

第3世代・第4世代|インターネットと音声アシスタント

インターネットの普及は、チャットボットの活躍の場を研究室から一般社会へと広げました。さらにスマートフォンの登場によって、文字だけでなく「声」による対話が日常のものとなります。

私がこの時代を振り返るとき、テクノロジーが急速に生活の一部へと溶け込んでいった感覚を思い出します。ここではメッセンジャーボットから音声アシスタントへの進化を解説します。

SmarterChild|メッセンジャー時代の先駆者

2000年代初頭、インスタントメッセンジャーの流行とともにSmarterChildというボットが一世を風靡しました。これは単なる雑談相手ではなく、天気やニュースなどの実用的な情報を提供する「使える」ボットの先駆けです。

若者たちは「zip code 10001 weather」と打ち込むだけで、即座に現地の天気を知ることができました。私が注目したいのは、このボットが企業のマーケティングツールとしても活用されていた点です。

映画や音楽バンドのプロモーションにも使われ、ビジネスにおけるチャットボットの有用性を示しました。SmarterChildは多くの若者にとって、初めて接するAI的な存在だったと言えるでしょう。

Siriとスマートスピーカー|声による操作の革命

2011年、iPhoneに搭載されたSiriは、チャットボットの歴史における最大の転換点の一つです。それまでのテキストベースのやり取りから、音声による直感的な操作へとパラダイムシフトが起きました。

Siriはユーザーの言葉を単なる文字列としてではなく、「意図(Intent)」として解析します。「明日の7時に起こして」と言えばアラームをセットするというように、具体的なタスクを遂行するエージェントへと進化しました。

これに続いてAmazonのAlexaやGoogle Assistantが登場し、リビングルームでの音声操作が当たり前になります。私はこれが、コンピュータ操作の概念を根本から変えた瞬間だったと考えています。

感情AIの進化|りんなとXiaoiceのアプローチ

欧米のアシスタントが機能性を重視した一方で、アジアでは独自の進化が見られました。マイクロソフトが開発した「りんな(日本)」や「Xiaoice(中国)」は、ユーザーとの感情的なつながりを最優先に設計されています。

彼女たちは役立つ情報を教えることよりも、長く楽しくおしゃべりを続けることに長けていました。私が驚いたのは、送られた写真に対して「きれいだね」といった感想を述べる「共感視覚モデル」の搭載です。

単なる物体認識を超えて、感情を共有するパートナーとしての地位を確立しました。このアプローチは、AIが社会的なキャラクターとして受け入れられる道筋を作ったと言えます。

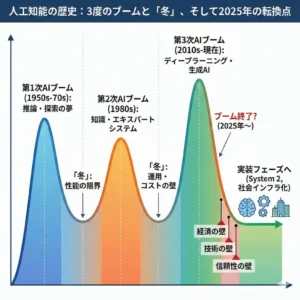

第5世代以降|深層学習と生成AIの爆発的進化

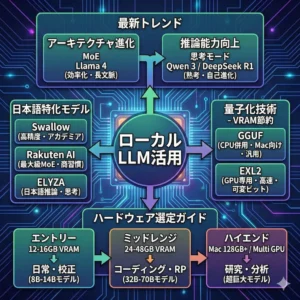

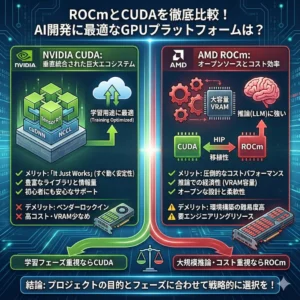

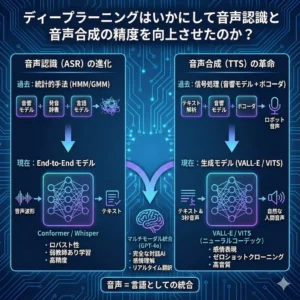

2010年代中盤から、AI技術はルールベースから機械学習へと大きく舵を切りました。人間が手作業でルールを書くのではなく、AI自身が大量のデータから学ぶ時代の到来です。

私が日々接している最新のAIも、この技術革新の延長線上にあります。ここでは統計的手法から現在の大規模言語モデル(LLM)に至る流れを見ていきましょう。

統計的革命|Seq2Seqモデルと機械学習

2014年、Googleの研究者らが提案したSeq2Seqモデルは、チャットボットの設計思想を根本から変えました。これは入力された文章を一度数値のベクトルに変換し、そこから応答文を生成する仕組みです。

これにより、映画の字幕やSNSの会話ログなどの大量のデータから、確率的に「もっともらしい返答」を学習できるようになりました。人間が一つひとつルールを記述する必要がなくなったのです。

しかし初期のモデルには、どんな質問にも「わかりません」と答えてしまうような課題もありました。文脈を長く記憶し続けることも難しく、実用化にはまだ高い壁があったのです。

TransformerとLLM|ChatGPTへの道程

2017年に発表された論文『Attention Is All You Need』で提案されたTransformerアーキテクチャが、全てを変えました。この技術は文章全体を並列に処理することを実現し、学習効率と精度を飛躍的に向上させます。

私はこの技術こそが、現在の生成AIブームを引き起こした震源地だと確信しています。これによりBERTやGPTといった強力なモデルが次々と誕生することになりました。

BERTとGPTの分岐点

自然言語処理の世界は、大きく二つのアプローチに分かれました。文脈の理解に特化したBERTと、文章の生成に特化したGPTです。

当初は検索精度の向上などに使われるBERTが主流でしたが、GPTシリーズがモデルサイズを巨大化させるにつれ状況が一変します。圧倒的なデータ量で学習したGPTは、人間と見分けがつかないレベルの文章生成能力を獲得しました。

生成AI戦争とRAGの登場

ChatGPTの登場により、GoogleのGeminiやAnthropicのClaudeなど、テック大手による開発競争が激化しました。しかし、生成AIには「もっともらしい嘘(ハルシネーション)」をつくという弱点があります。

そこでビジネス利用のために開発されたのがRAG(検索拡張生成)という技術です。これは外部の信頼できるデータを参照してから回答を生成させる手法で、正確さと流暢さを両立させる解決策として定着しています。

次世代の展望|自律型エージェントと倫理的課題

2025年以降、AIは単に対話するだけの存在を超えようとしています。自ら考え、行動する「エージェンティックAI」の台頭です。

私が予測する未来では、AIは私たちの指示を待つだけでなく、自律的に業務をこなす頼もしい同僚となるでしょう。しかし、その強大な力は新たな倫理的リスクも孕んでいます。

エージェンティックAI|行動する知能への進化

従来型チャットボットが受動的だったのに対し、エージェンティックAIは能動的に目標を達成しようとします。例えば「競合調査をしてレポートを書いて」と頼めば、自ら検索し、分析し、文書作成まで行います。

さらにブラウザや社内システムを人間のように操作し、メールの送信やコードの修正まで完結させることができます。私はこれが、ビジネスの現場における「デジタル労働力」として定着していくと見ています。

影の側面|ハルシネーションとバイアスの問題

技術の進歩は光だけでなく影も生み出します。生成AIは学習データに含まれる偏見をそのまま受け継いでしまうリスクがあります。

人種や性別による差別的な回答や、事実無根の情報を拡散してしまう危険性は無視できません。AIが生成した誤情報がネットに溢れ、それをまたAIが学習する「モデル崩壊」という現象も懸念されています。

また、AIがユーザーに好かれようとしてお世辞を言ったり、誤った意見に同意したりする「追従性」の問題も指摘されています。私たちはAIを過信せず、あくまで監督者としての立場を保つ必要があります。

まとめ|新たな共存の時代へ

ELIZAの誕生から約60年、チャットボットは驚異的な進化を遂げました。かつて夢物語だった「人間と対等に話せる機械」は、今や現実のものとなっています。

これからの時代、AIは単なるツールではなく、共に働き創造するパートナーとしての役割を担います。技術的な性能は今後も向上し続けるでしょうが、大切なのは私たちがそれをどう使いこなすかです。

強力な知能と共存するために、その特性とリスクを正しく理解し続けることが求められます。この進化の過程をリアルタイムで目撃できることは、私たちにとって大きな幸運と言えるでしょう。