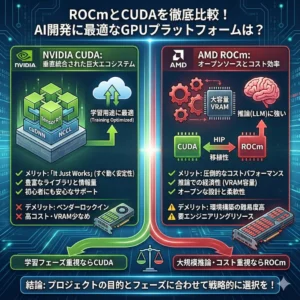

私は最新のAI技術に触れるたびに、その進化の速さに驚かされます。ChatGPTのような高度なAIを支えているのは、CUDAというNVIDIA独自の技術です。

AIの計算を劇的に速くする仕組みを知ることで、なぜNVIDIAが世界をリードしているのかが見えてきます。私はこの記事を通じて、初心者の方にもCUDAの本質をわかりやすく伝えます。

CUDAの正体とNVIDIAが最強な理由

CUDAはグラフィックボードを巨大な計算機に変えるためのプラットフォームです。私はこの技術こそが、現代のAI革命を引き起こした真の主役だと考えています。

GPUという画像処理用のパーツに、汎用的な計算をさせる命令を出すのがCUDAの役割です。私はこの「現場監督」のような働きが、AIの学習効率を極限まで高めていると確信しています。

CPUとGPUの違いを料理に例える

CPUは一人の天才シェフであり、GPUは千人の見習いコックの集団といえます。複雑なレシピを読み解くのはシェフが得意ですが、大量の野菜を刻む作業はコック集団が圧倒的に速いといえます。

AIの計算は「単純な足し算や掛け算の膨大な繰り返し」であり、見習いコックの集団であるGPUが得意とする分野です。私はこの並列処理の仕組みをCUDAが束ねている点に注目しています。

一度に数千のタスクを同時にこなすパワーは、従来のCPUでは到底太刀打ちできません。私はこの圧倒的な処理スピードが、生成AIの回答速度に直結していると断言します。

汎用計算機としての進化

CUDAが登場する以前、GPUはゲームの画面を出すためだけの専門パーツでした。NVIDIAは2006年にCUDAを発表し、誰でもプログラミングでGPUの力を計算に使えるようにしました。

この決断が、後にディープラーニングというAIの巨大な波を捉えることにつながりました。私はこの先見の明があったからこそ、現在のNVIDIAの独走状態が生まれたと分析しています。

現在では気象予測や創薬シミュレーションなど、科学の最前線でCUDAが使われています。私は汎用性を追求したCUDAのエコシステムが、競合他社には真似できない大きな壁になっていると感じています。

CUDAの仕組みとAIを支える中核技術

CUDAの内部には、特定の計算を加速させるための特殊な回路が組み込まれています。私はハードウェアとソフトウェアが密接に連携する設計に、NVIDIAの強さの源泉を見出しています。

効率を極めた設計によって、電力を抑えつつ最高のパフォーマンスを引き出す仕組みが整っています。私はこの無駄のないアーキテクチャが、データセンターの運営コスト削減にも寄与していると確信しています。

TensorコアとAI計算の加速

AIの学習や推論には、行列の掛け算という特殊な計算が大量に発生します。Tensorコアは、この行列計算を専門に行うために開発された強力なアクセラレータです。

通常の計算ユニットよりも数倍から数十倍の速さで処理を完了させることができます。私はChatGPTが滑らかに言葉を紡ぎ出す背景には、このTensorコアの働きがあると考えています。

最新世代のチップでは、さらに低精度な計算を賢く使うことで速度をさらに引き上げています。私は精度と速度のバランスを最適化する技術において、CUDAの右に出るものはいないと確信しています。

メモリ階層とデータの転送効率

計算ユニットがいくら速くても、データが届かなければ宝の持ち腐れになります。最新のGPUにはHBMという積層型の超高速メモリが搭載されており、データの渋滞を防いでいます。

バケツリレーで水を運ぶ際に、バケツを大きくしつつ通路を広げるようなイメージです。私はVRAMの帯域幅が、AIモデルの学習時間を短縮するための決定的な要因になると考えています。

さらに、GPU同士を直接つなぐNVLinkという技術で、複数のチップを一つの巨大な計算機として扱っています。私はこのスケールアップの容易さが、大規模言語モデルの開発を支えていると確信しています。

2025年のハードウェア選定と導入のコツ

CUDAを利用するためには、最適なGPUを選び、正しく環境を構築する必要があります。私は自身の経験から、用途に合わせた賢いハードウェアの選び方を提案します。

スペック表の数字だけに惑わされず、実務で重要になるポイントを押さえることが重要です。私は特にメモリ容量とドライバの安定性に重きを置くべきだと考えています。

おすすめのGPUモデル比較

初心者がAI学習を始めるなら、計算速度よりもビデオメモリの容量を優先すべきです。私はVRAMが不足すると学習すら開始できないため、16GB以上のモデルを強く推奨しています。

| ターゲット | 推奨モデル | VRAM容量 | 主な用途 |

|---|---|---|---|

| 学生・入門者 | RTX 4060 Ti 16GB | 16GB | 画像生成・小規模な学習 |

| ハイアマチュア | RTX 4090 | 24GB | LLMの構築・本格的な研究 |

| クリエイター | RTX 5000シリーズ | 32GB以上 | 3DCG制作・動画編集 |

安価なモデルでもVRAMが多いものを選べば、最新のAIモデルを動かすことができます。私は予算を抑えつつ最大限の成果を出すためには、中古市場も含めた賢い選択が有効だと確信しています。

ドライバの選択とトラブル回避

NVIDIAのドライバには、ゲーム用のGame Readyと仕事用のStudioの二種類があります。私はAI開発や動画編集を主目的とするならば、安定性の高いStudioドライバを選ぶことを推奨しています。

アップデートの頻度は低いものの、特定のアプリでの不具合が検証済みで安心して使えます。私はこの安定性こそが、締切に追われるプロフェッショナルにとって最大のメリットになると考えています。

WSL2というWindows上のLinux環境を使う際は、ドライバの入れ方に注意が必要です。私はWindows側にのみ最新ドライバを入れ、Linux側には入れないという鉄則を守ることがトラブル解決の近道だと断言します。

まとめ

CUDAは単なるプログラムの道具ではなく、AI時代の世界を動かすエンジンそのものです。私はこの技術の普及によって、人類の知能の拡張が加速していくと確信しています。

GPUの持つ膨大な並列処理能力を引き出すCUDAは、今後もテクノロジーの進化の中心に居続けるはずです。私はCUDAを理解し活用することが、これからの時代を生き抜くための強力な武器になると信じています。