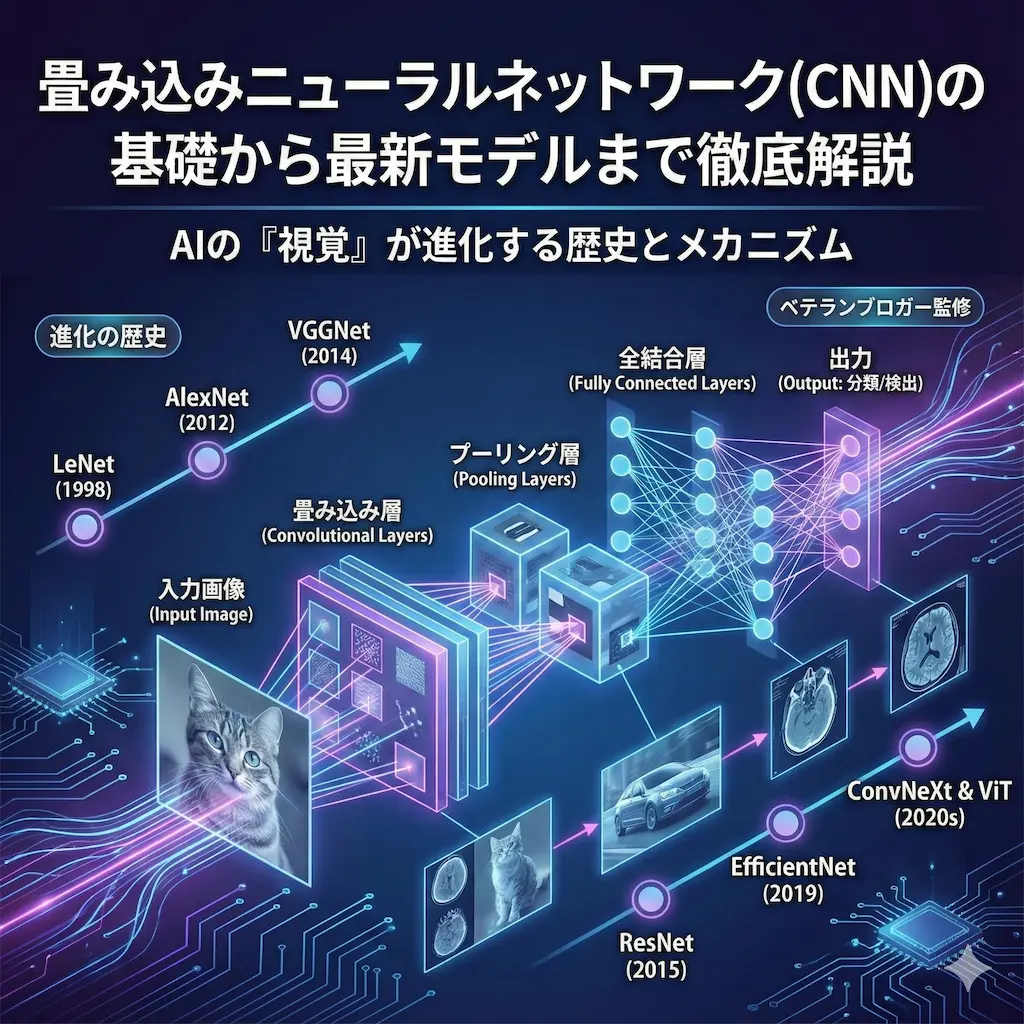

人工知能が視覚を手に入れた瞬間、世界は劇的に変わりました。私が長年AI技術を追う中で、畳み込みニューラルネットワーク(CNN)ほど革新的で、かつ美しいアーキテクチャに出会ったことはありません。画像認識のデファクトスタンダードであるCNNは、2025年の現在も進化を続けています。

本記事では、CNNの基礎原理から最新トレンドまでを網羅的に解説します。エンジニアからリサーチャーまで、誰もが納得できる内容を目指しました。これから学ぶ方は、AIの「目」がどのように機能しているかを深く理解できるでしょう。

CNNの基礎知識|仕組みと重要性を理解する

CNNは、画像や音声などグリッド状のデータ処理に特化した深層学習モデルです。私が初心者の方に説明するときは、よく「人間の視覚野を模倣したシステム」だと表現します。従来のニューラルネットワークとは異なり、画像の位置情報を保持したまま特徴を抽出できる点が最大の特徴です。

通常のニューラルネットワークは画像を1列の数値に変換してしまうため、形や配置の情報を失ってしまいます。対してCNNは、画像を画像のまま扱い、局所的な特徴から全体的な意味へと段階的に理解を深めていきます。この特性により、画像分類や物体検出において圧倒的な性能を発揮するのです。

視覚的知能の核心|CNNとは何か

CNNの中核にあるのは「畳み込み」という数学的な操作です。私がプログラミングで実装する際も、この畳み込み層がデータの特徴を捉えるフィルターの役割を果たしていると実感します。フィルターを通すことで、画像のエッジやテクスチャといった単純な特徴を浮き彫りにします。

層が深くなるにつれて、抽出される特徴はより抽象的で高度なものになります。最初は「線」や「点」しか認識していなかったネットワークが、次第に「目」や「耳」を認識し、最終的には「猫」や「犬」といった物体そのものを理解するようになります。この階層的な学習プロセスこそが、CNNの強力な識別能力の源泉です。

生物学的起源|猫の視覚野から生まれた技術

CNNの設計思想は、実は生物学的な発見に深く根ざしています。1950年代に行われた猫の視覚野に関する研究が、全ての始まりでした。視覚野には特定の傾きを持つ線に反応する細胞と、位置ズレを許容する細胞があることが発見されました。

- 単純細胞|特定の位置にある特定の特徴に反応する

- 複雑細胞|特徴の位置が多少ずれても反応する

この「特徴抽出」と「位置不変性」という2つのメカニズムを工学的に再現したのがCNNです。私がこの歴史を知ったとき、生物の進化とAIの進化が重なり合う様子に深い感銘を受けました。ネオコグニトロンというモデルを経て、現在の洗練されたアーキテクチャへと進化を遂げてきたのです。

数理的基礎|画像処理のメカニズム

CNNが画像を理解するプロセスは、魔法ではなく純粋な数学的演算の積み重ねです。私が講義を行う際も、この数理的な基礎を理解することの重要性を強調しています。基本となる構成要素を知ることで、最新のモデルがなぜ高性能なのかが見えてきます。

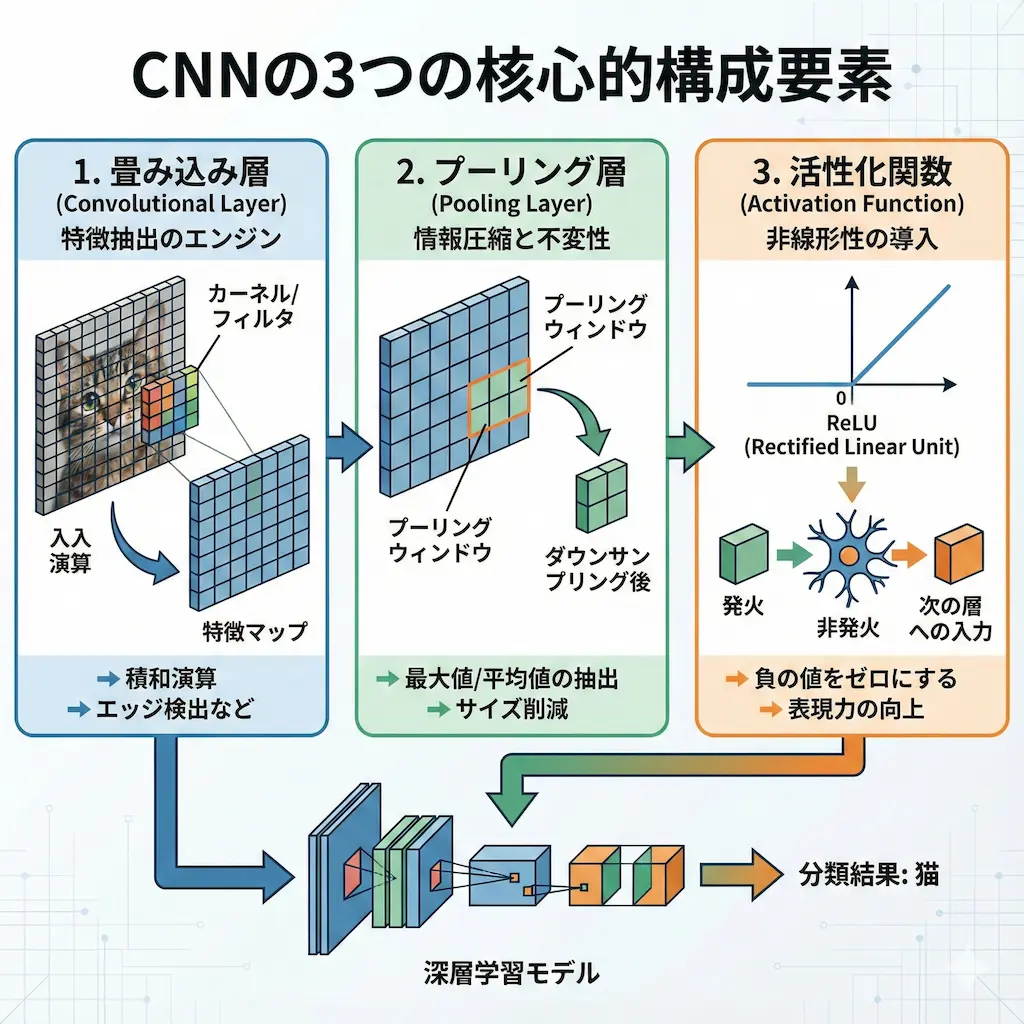

主要な構成要素は以下の3つです。

- 畳み込み層|特徴を抽出する

- プーリング層|情報を圧縮し、ズレに強くする

- 活性化関数|複雑な表現力を与える

これらをブロックのように積み上げることで、ネットワークは構成されます。

畳み込み層|特徴抽出のエンジン

畳み込み層は、カーネルと呼ばれる小さなフィルターを画像の上でスライドさせながら積和演算を行います。私が画像処理のコードを書くときは、このカーネルサイズやストライド(移動幅)の設計に最も頭を悩みませます。カーネルが画像の特徴をスキャンし、特徴マップと呼ばれる新しい画像を生成します。

ここで重要なのが「重み共有」という概念です。画像のある部分で見つけた「縦の線」という特徴は、画像の別の場所でも同じく重要であるはずです。そのため、同じフィルターを画像全体で使い回すことができます。これにより、学習すべきパラメータ数を劇的に減らしつつ、効率的な学習を実現しています。

プーリング層と活性化関数|不変性と非線形性

抽出された特徴マップは、そのままでは情報量が多すぎます。そこで登場するのがプーリング層です。私がよく使うMax Poolingは、特定の領域内の最大値だけを取り出す操作です。これにより画像サイズを小さくしながら、最も目立つ特徴だけを残すことができます。

さらに、ニューラルネットワークに表現力を持たせるために活性化関数が不可欠です。AlexNet以降、ReLU(Rectified Linear Unit)という関数が標準的に使われるようになりました。これは負の値をゼロにするだけの単純な関数ですが、学習の速度と精度を劇的に向上させます。私が実験する中でも、ReLUの採用はモデルの収束を早める決定打となります。

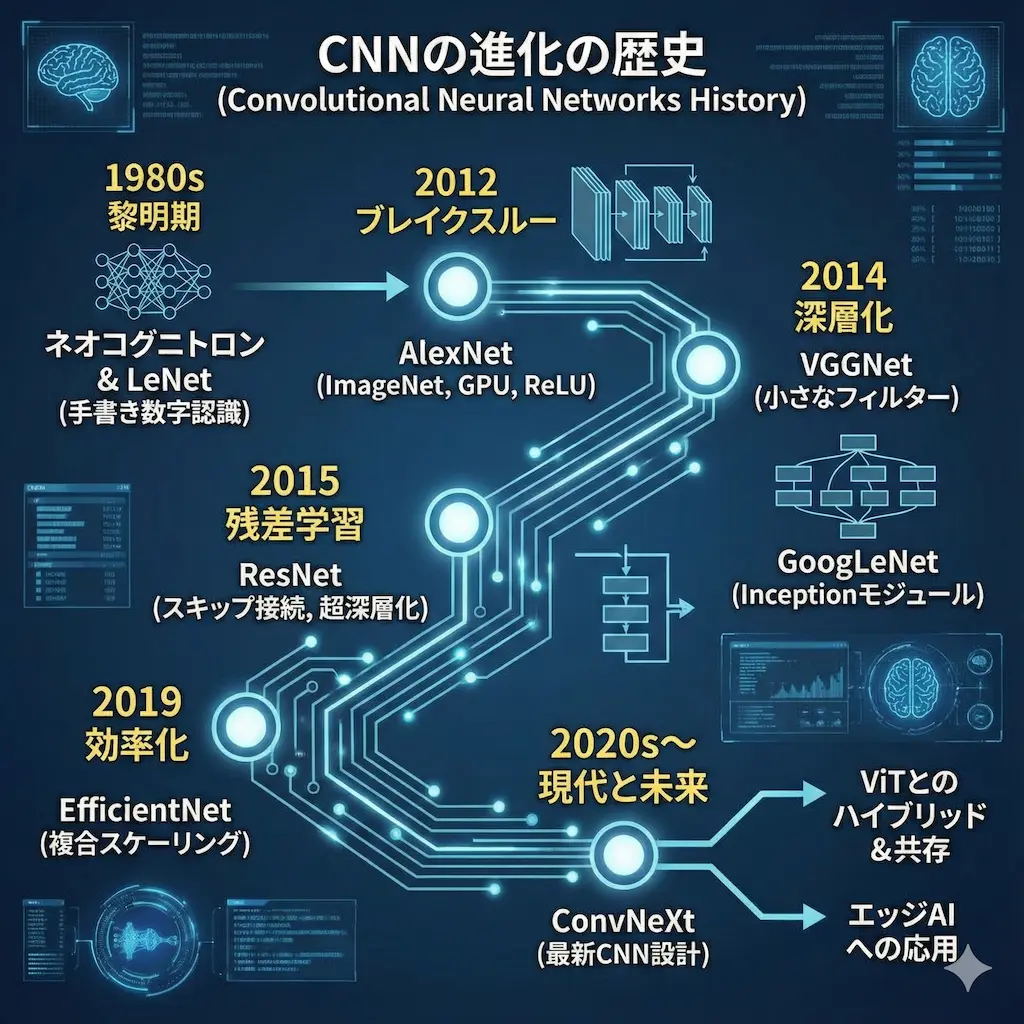

進化の歴史|深層化と効率化の系譜

CNNの歴史は、より深く、より効率的な構造を追求する旅路でした。私が業界に入った頃から現在に至るまで、毎年新しいアーキテクチャが提案され、記録が塗り替えられてきました。この進化の過程を知ることは、現代のAI開発においても非常に有用な知見となります。

黎明期から第2世代|LeNetからVGGまで

初期の代表作であるLeNetは手書き数字認識で成功を収めましたが、大規模な画像認識には力不足でした。潮目が変わったのは2012年のAlexNetの登場です。GPUを活用した学習とReLUの導入により、圧倒的な精度でコンペティションを制しました。

その後、VGGNetが登場し「深さ」の重要性が示されました。小さなフィルターを何度も重ねることで、表現力を高めるアプローチです。私が転移学習を行う際、今でもVGGをベースモデルとして選ぶことがあります。そのシンプルで均質な構造は、特徴抽出器として非常に扱いやすいからです。

ブレイクスルー|ResNetと残差学習

層を深くすればするほど性能が上がると思われていましたが、ある段階を超えると逆に精度が落ちる問題が発生しました。この壁を打ち破ったのがResNetです。スキップ接続というアイデアを導入し、入力情報を出力側にそのまま加算するバイパスを作りました。

- 勾配消失の解消|深い層まで学習信号が届く

- 学習の安定化|超深層ネットワークの構築を実現

この仕組みにより、100層を超えるネットワークでも学習できるようになりました。私が初めてResNetの論文を読んだとき、その発想のシンプルさと効果の大きさに衝撃を受けました。現在でも多くのモデルの基礎となっています。

現代的設計|EfficientNetとConvNeXt

近年では、単に精度を追うだけでなく、計算効率も重視されるようになりました。EfficientNetは、モデルの深さ・幅・解像度をバランスよく拡大する「複合スケーリング」を提案しました。これにより、少ない計算資源で最高レベルの精度を出すことができます。

さらに2020年代に入り、Vision Transformer (ViT) という強力なライバルが登場しました。これに対抗するために開発されたのがConvNeXtです。最新のトレンドを取り入れた純粋なCNNでありながら、ViTに匹敵する性能を誇ります。私が最近の実装でConvNeXtを選ぶ理由は、その学習のしやすさと推論速度の速さにあります。

応用技術と実装|社会実装の最前線

理論だけでなく、実際にどう使われているかを知ることも重要です。私が携わってきたプロジェクトでも、CNNは単なる画像分類を超えて様々なタスクに応用されています。ここでは代表的な応用技術を紹介します。

物体検出とセグメンテーション|YOLOとU-Net

画像の中に「何が」「どこに」あるかを知る物体検出では、YOLO (You Only Look Once) シリーズが有名です。その名の通り、一度の処理で物体の位置と種類を特定します。動画解析などのリアルタイム性が求められる現場で、私が最も信頼を置いているモデルの一つです。

一方、ピクセル単位で画像の領域を分割するセグメンテーションには、U-Netが使われます。医療画像解析などで必須の技術であり、エンコーダとデコーダをスキップ接続で結ぶ独特の形状をしています。この構造は、最近話題の画像生成AI「Stable Diffusion」の内部でも使われています。

2025年の現在地|ViTとの共存とハイブリッド

現在はCNNとViTが互いの長所を取り入れながら進化しています。CNNは局所的な特徴を捉えるのが得意で、ViTは大域的な関係性を捉えるのが得意です。私が最新の論文を読むと、これらを組み合わせたハイブリッドモデルが増えていることに気づきます。

例えば、画像の浅い層ではCNNを使って効率的に特徴を抽出し、深い層ではTransformerを使って全体の文脈を理解する構成です。これにより、計算コストを抑えつつ高い認識精度を実現します。エッジデバイスなどの制約がある環境では、依然として軽量なCNNが主役の座を守り続けています。

まとめ

CNNは、AIが視覚情報を理解するための基盤技術として確固たる地位を築いています。生物学的な知見から始まり、数理的な工夫とアーキテクチャの革新を経て、現代の高度なAIシステムへと進化しました。私がこれまで見てきた技術の中でも、これほど汎用性が高く、かつ進化の余地を残している技術は稀です。

これからのAI開発においても、CNNの知識は必須の教養となります。基礎原理を理解し、最新のモデルを適切に選択・実装できるスキルは、エンジニアとしての大きな武器になるでしょう。技術の進化は止まりませんが、その本質にあるメカニズムは変わりません。この記事が、あなたのAI学習の確かな道しるべとなることを願っています。